Может ли компьютер обладать сознанием.

Инноваторы. Как несколько гениев, хакеров и гиков совершили цифровую революцию Айзексон Уолтер

Может ли машина мыслить?

Может ли машина мыслить?

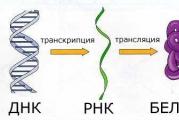

Когда Алан Тьюринг раздумывал о конструировании компьютера с сохраняемой программой, он обратил внимание на утверждение, сделанное Адой Лавлейс столетием ранее, в ее финальном «Примечании» к описанию аналитической машины Бэббиджа. Она утверждала, что машины не смогут думать. Тьюринг задался вопросом: если машина может изменить свою собственную программу на основе обрабатываемой ею информации, не форма ли это обучения? Не может ли это привести к созданию искусственного интеллекта?

Вопросы, связанные с искусственным интеллектом, возникали уже в древности. Тогда же возникали и вопросы, связанные с человеческим сознанием. Как и в большинстве обсуждений такого рода, важную роль в изложении их в современных терминах сыграл Декарт. В своем трактате 1637 года «Рассуждение о методе» (который содержит знаменитое утверждение «Я мыслю, следовательно, я существую») Декарт писал:

Если бы сделать машины, которые имели бы сходство с нашим телом и подражали бы нашим действиям, насколько это мыслимо, то у нас все же было бы два верных средства узнать, что это не настоящие люди. Во-первых, такая машина никогда не могла бы пользоваться словами или другими знаками, сочетая их так, как это делаем мы, чтобы сообщать другим свои мысли. Во-вторых, хотя такая машина многое могла бы сделать так же хорошо и, возможно, лучше, чем мы, в другом она непременно оказалась бы несостоятельной, и обнаружилось бы, что она действует несознательно.

Тьюринга уже давно интересовало, как компьютер мог бы повторить работу человеческого мозга, и его любопытство было подогрето еще больше работой на машинах, которые расшифровывали закодированные сообщения. В начале 1943 года, когда в Блетчли-Парке уже был готов Colossus, Тьюринг пересек Атлантику и направился в Bell Lab, расположенный в Нижнем Манхэттене, для консультаций с группой, работающей над шифрованием речи с помощью электронного устройства (скремблера) - технологией, которая могла бы зашифровывать и расшифровывать телефонные разговоры.

Там он встретился с колоритным гением - Клодом Шенноном, который, будучи выпускником Массачусетского технологического института, в 1937 году написал дипломную работу, ставшую классической. В ней он показал, как булева алгебра, которая представляет логические предложения в виде уравнений, может быть отображена с помощью электронных схем. Шеннон и Тьюринг стали встречаться за чаем и вести долгие разговоры. Оба интересовались наукой о мозге и понимали, что в их работах 1937 года было нечто общее и фундаментальное: они показали, как машине, которая оперирует простыми двоичными командами, можно ставить не только математические, но и всевозможные логические задачи. А поскольку логика была основой человеческого мышления, то машина могла бы в теории воспроизвести человеческий интеллект.

«Шеннон хочет кормить [машину] не только данными, но и произведениями культуры! - однажды сказал Тьюринг коллегам по Bell Lab на обеде. - Он хочет сыграть ей что-нибудь музыкальное». На другом обеде в столовой Bell Labs Тьюринг вещал своим высоким голосом, слышным всем присутствовавшим в помещении: «Нет, я не собираюсь конструировать мощный мозг. Я пытаюсь сконструировать всего лишь посредственный мозг - такой, например, как у президента Американской телефонной и телеграфной компании» .

Когда в апреле 1943 года Тьюринг вернулся в Блетчли-Парк, он подружился с коллегой Дональдом Мичи, и они провели много вечеров, играя в шахматы в соседнем пабе. Они часто обсуждали возможность создания шахматного компьютера, и Тьюринг решил подойти к проблеме по-новому. А именно: не использовать напрямую всю мощность машины для расчета каждого возможного хода, а постараться дать машине возможность самой учиться игре в шахматы, постоянно практикуясь. Другими словами, дать ей возможность пробовать применить новые гамбиты и совершенствовать свою стратегию после каждого нового выигрыша или проигрыша. Такой подход в случае успеха являлся бы существенным прорывом, который порадовал бы Аду Лавлейс. Было бы доказано, что машины способны на большее, чем просто следовать инструкциям, данным им людьми, - они могли бы учиться на опыте и улучшать свои собственные команды.

«Считается, что вычислительные машины могут выполнять только такие задачи, на которые им даны команды, - объяснил он в докладе, сделанном на Лондонском математическом обществе в феврале 1947 года. - Но необходимо ли, чтобы они всегда использовались таким образом?» Затем он обсудил возможности новых компьютеров с сохраняемой программой, которые могут сами изменять таблицы команд, и продолжил: «Они могли бы стать похожими на учеников, которые многому научились у своего учителя, но добавили гораздо больше своего. Я думаю, что, когда это произойдет, придется признать, что машина демонстрирует наличие интеллекта» .

Когда он закончил доклад, слушатели на мгновение замолкли, ошеломленные заявлением Тьюринга. Его коллеги из Национальной физической лаборатории вообще не понимали одержимости Тьюринга созданием думающих машин. Директор Национальной физической лаборатории сэр Чарльз Дарвин (внук биолога, создателя теории эволюции) в 1947 году написал своему начальству, что Тьюринг «хочет распространить свою работу над машиной еще дальше, в сторону биологии» и ответить на вопрос: «Можно ли сделать такую машину, которая может учиться на своем опыте?»

Смелая мысль Тьюринга о том, что машины смогут когда-нибудь думать, как люди, в то время вызвала яростные возражения, да и до сих пор вызывает. Появились как вполне ожидаемые религиозные возражения, так и нерелигиозные, но весьма эмоциональные, как по содержанию, так и по тону. Нейрохирург сэр Джеффри Джефферсон в речи, произнесенной по случаю награждения престижной медалью Листера в 1949 году, заявил: «Согласиться с тем, что машина так же разумна [как человек], мы сможем не раньше, чем она сможет написать сонет или сочинить концерт под влиянием своих мыслей и эмоций, а не из-за случайного выбора символов» . Ответ Тьюринга репортеру из лондонского Timss, казалось, был несколько легкомысленным, но тонким: «Сравнение, возможно, не совсем справедливо, поскольку сонет, написанный машиной, лучше оценивать другой машине» .

Таким образом, был заложен фундамент для второй основополагающей работы Тьюринга, «Вычислительные машины и разум», опубликованной в журнале Mind в октябре 1950 года . В ней он описал тест, ставший известным впоследствии как тест Тьюринга. Он начал с четкого заявления: «Я предлагаю рассмотреть вопрос: „Могут ли машины мыслить?“» С азартом, скорее присущим школьнику, он придумал игру - и в нее все еще играют и до сих пор обсуждают. Он предложил вложить в этот вопрос реальный смысл и сам дал простое функциональное определение искусственного интеллекта: если ответ машины на вопрос ничем не отличается от ответа, который дает человек, то у нас не будет никакого разумного основания считать, что машина не «думает».

Тест Тьюринга, который он назвал «Игра в имитацию», прост: экзаменатор направляет письменные вопросы человеку и машине, находящимся в другой комнате, и пытается определить, какой из ответов принадлежит человеку. Тьюринг предложил пример вопросника:

Вопрос: Пожалуйста, напишите мне сонет о мосте Форт.

Ответ: Не просите меня об этом. Я никогда не умел писать стихи.

В: Сложите 34 957 и 70 764.

О (пауза примерно 30 секунд, а затем дается ответ): 105 621.

В: Вы играете в шахматы?

В: У меня есть только K (король) на K 1 , и никаких других фигур.

У вас есть только K на K6 и R (ладья) на R1. Ваш ход. Куда вы ходите?

О (после паузы 15 секунд): R на R8, мат.

В этом примере Тьюринга диалога содержится несколько важных вещей. Тщательное изучение показывает, что отвечающий после тридцатисекундного раздумья сделал небольшую ошибку в сложении (правильный ответ 105 721). Свидетельствует ли это о том, что он был человеком? Возможно. Но опять же, может быть, эта хитрая машина притворилась человеком. Тьюринг также ответил на соображение Джефферсона о том, что машина не может написать сонет: вполне возможно, что ответ, приведенный выше, был дан человеком, признавшимся, что он не умеет писать стихи. Далее в статье Тьюринг представил еще один воображаемый опрос, демонстрирующий сложность использования умения сочинить сонет в качестве критерия принадлежности к человеческому роду:

В: Считаете ли вы, что первую строку сонета: «Должен ли я сравнить тебя с летним днем» не испортит, а может, даже улучшит замена на «весенний день»?

О: Тогда нарушится размер.

В: Как насчет замены на «зимний день»? Тогда с размером все в порядке.

О: Да, но никто не хочет быть сравненным с зимним днем.

В: Вы хотите сказать, что мистер Пиквик напоминает вам о Рождестве?

О: В некотором смысле.

В: Тем не менее праздник Рождества приходится на зимний день, и я не думаю, что мистер Пиквик возражал бы против этого сравнения.

О: Я не думаю, что вы говорите серьезно. Под зимним днем обычно понимают типичный зимний день, а не особенный, вроде Рождества.

Смысл примера Тьюринга в том, что может оказаться невозможным сказать, отвечающий был человеком или машиной, делающей вид, что она человек.

Тьюринг высказал свое предположение о том, может ли компьютер выиграть в этой имитационной игре: «Я считаю, в течение примерно пятидесяти лет можно будет научиться так программировать компьютеры… что они смогут играть в имитацию настолько хорошо, что шанс среднего экзаменатора правильно идентифицировать отвечающего после пятиминутного опроса будет не более 70 %».

В своей работе Тьюринг попытался опровергнуть множество возможных возражений на его определение разума. Он отмахнулся от теологического довода о том, что Бог даровал душу и разум только людям, возразив, что это «подразумевает серьезное ограничение на всемогущество Всевышнего». Он спросил, есть ли у Бога «свобода даровать душу слону, если Он сочтет это нужным». Предположим, что так. Из той же логики (которая, учитывая, что Тьюринг был неверующим, звучит язвительно) следует, что Бог, безусловно, может даровать душу и машине, если Он того пожелает.

Самое интересное возражение, на которое Тьюринг отвечает, - особенно для нашего повествования - это возражение Ады Лавлейс, написавшей в 1843 году: «Аналитическая машина не претендует на то, чтобы создавать что-то действительно новое. Машина может выполнить все то, что мы умеем ей предписать. Она может следовать анализу, но не может предугадать какие-либо аналитические зависимости или истины». Другими словами, в отличие от человеческого разума, механическое устройство не может иметь свободу воли или выдвигать свои собственные инициативы. Оно может только выполнять то, что запрограммировано. В своей статье 1950 года Тьюринг посвятил раздел этому высказыванию и назвал его «Возражение леди Лавлейс».

Гениальным ответом на это возражение был аргумент, что на самом деле машина может учиться, тем самым превращаясь в мыслящее исполнительное устройство, которое способно производить новые мысли. «Вместо того чтобы писать программу для имитации мышления взрослого человека, почему бы не попробовать написать программу, которая имитирует мышление ребенка? - спрашивает он. - Если запустить соответствующий процесс обучения, можно было бы в конце концов получить интеллект взрослого человека». Он признал, что процесс обучения компьютера будет отличаться от процесса обучения ребенка: «К примеру, его невозможно снабдить ногами, так что ему нельзя предложить сходить собрать уголь в ящик. Вероятно, у него не может быть глаз… Нельзя послать это существо в школу - для других детей оно будет посмешищем». Поэтому бэби-машина должна обучаться по-иному. Тьюринг предложил систему наказаний и наград, которая будет поощрять машину повторять некоторые действия и избегать других. В конце концов такая машина могла бы развивать свои собственные представления и объяснения того или иного явления.

Но даже если машина сможет имитировать разум, возражали критики Тьюринга, он будет не совсем разумом. Когда человек проходит тест Тьюринга, он использует слова, которые связаны с реальным миром, эмоциями, переживаниями, ощущениями и восприятиями. А машина не делает этого. Без таких связей язык становится просто игрой, оторванной от смысла.

Это возражение привело к продержавшемуся дольше всех опровержению теста Тьюринга, которое сформулировал философ Джон Сёрл в своем эссе 1980 года. Он предложил мысленный эксперимент, называемый «Китайской комнатой», в которой говорящему по-английски человеку, не знающему китайского языка, предоставляется полный свод правил, объясняющих, как составлять любые комбинации китайских иероглифов. Ему передается набор иероглифов, а он из них составляет сочетания, пользуясь правилами, но не понимая значения фраз, составленных им. Если инструкции достаточно хороши, человек мог бы убедить экзаменатора, что он действительно говорит по-китайски. Тем не менее он не понял бы ни одного составленного им самим текста, в нем не содержалось бы никакого смысла. В терминологии Ады Лавлейс он не претендовал бы на создание чего-то нового, а просто выполнял действия, которые ему было приказано выполнять. Аналогично и машина в имитационной игре Тьюринга, независимо от того, насколько хорошо она может имитировать человеческий разум, не будет понимать или сознавать ничего из того, что говорится. В том, чтобы сказать, что машина «думает», не больше смысла, чем в том, чтобы сказать, что человек, следующий многочисленным инструкциям, понимает китайский язык .

Одним из ответов на возражения Сёрла стало утверждение, что, даже если человек не понимает китайский язык, вся система как целое, собранная в Китайской комнате, то есть мужчина (блок обработки данных), инструкция по обращению с иероглифами (программа) и файлы с иероглифами (данные), возможно, действительно понимает китайский язык. Здесь нет окончательного ответа. И в самом деле, тест Тьюринга и возражения на него остаются по сей день наиболее обсуждаемой темой в когнитивных науках.

В течение нескольких лет после того, как Тьюринг написал «Вычислительные машины и разум», он, казалось, наслаждался участием в перепалке, которую сам спровоцировал. С едким юмором он парировал притязания тех, кто болтал о сонетах и возвышенном сознании. В 1951 году он подтрунивал над ними: «Однажды дамы возьмут свои компьютеры с собой на прогулку в парк и будут говорить друг другу: „Мой компьютер рассказывал сегодня утром такие забавные вещи!“» Как заметил позже его наставник Макс Ньюман, «его юмористические, но блестяще точные аналогии, пользуясь которыми он излагал свои взгляды, делали его восхитительным собеседником» .

Была одна тема, которая не раз поднималась в ходе обсуждений с Тьюрингом и которая вскоре станет печально актуальной. Она касалась роли сексуальности и эмоциональных желаний, неведомых машинам, в работе человеческого мозга. Примером могут служить публичные дебаты, состоявшиеся в январе 1952 года на телевизионном канале BBC между Тьюрингом и нейрохирургом сэром Джеффри Джефферсоном. Модераторами на этом диспуте были математик Макс Ньюман и философ науки Ричард Брейтуэйт. Брейтуэйт, утверждавший, что для того, чтобы создать настоящую думающую машину, «необходимо оснастить машину чем-то подобным набору физических потребностей», заявил: «Интересы человека определяются по большому счету его страстями, желаниями, мотивацией и инстинктами». Ньюман вмешался, сказав, что машины «имеют довольно ограниченные потребности и они не могут краснеть, когда смущаются». Джефферсон пошел еще дальше, неоднократно используя в качестве примера термин «сексуальные потребности» и ссылаясь на человеческие «эмоции и инстинкты, например имеющие отношение к сексу». «Человек - жертва сексуальных желаний, - сказал он, - и может выставить себя дураком». Он говорил так много о том, как сексуальные потребности влияют на человеческое мышление, что редакторы BBC вырезали некоторые из его высказываний из передачи, в том числе утверждение, что он не поверит, что компьютер может думать, пока не увидит, что он потрогает ногу женщины-компьютера .

Тьюринг, который все еще скрывал свою гомосексуальность, замолк во время этой части обсуждения. В течение нескольких недель, предшествовавших записи передачи 10 января 1952 года, он совершил ряд поступков, которые были настолько сугубо человеческими, что машина сочла бы их непостижимыми. Он только что закончил научную работу, а потом написал рассказ о том, как собирался отпраздновать это событие: «Прошло довольно много времени с тех пор, как у него „был“ кто-то, фактически с лета прошлого года, когда он встретил того солдата в Париже. Теперь, когда его работа закончена, он может с полным основанием считать, что заработал право на отношения с геем, и он знал, где найти подходящего кандидата» .

В Манчестере на Оксфорд-стрит Тьюринг нашел девятнадцатилетнего бомжа по имени Арнольд Мюррей и завязал с ним отношения. Когда он вернулся с BBC после записи шоу, он пригласил Мюррея переселиться к нему. Однажды ночью Тьюринг рассказал молодому Мюррею о своей идее сыграть в шахматы против подлого компьютера, которого он смог бы победить, заставляя его проявлять то гнев, то радость, то самодовольство. Отношения в последующие дни стали более сложными, и однажды вечером Тьюринг вернулся домой и обнаружил, что его обокрали. Преступник оказался другом Мюррея. Тьюринг сообщил о случившемся в полицию, ему пришлось в конечном итоге рассказать полицейским о своих сексуальных отношениях с Мюрреем, и Тьюринг был арестован за «непристойное поведение» .

На судебном процессе в марте 1952 года Тьюринг признал себя виновным, хотя ясно дал понять, что не чувствует никакого раскаяния. Макс Ньюман был вызван в суд в качестве свидетеля, дающего отзыв о характере подсудимого. Осужденный и лишенный допуска Тьюринг должен был сделать выбор: тюрьма или освобождение при условии прохождения гормональной терапии с помощью инъекций синтетического эстрогена, убивающего сексуальные желания и уподобляющего человека химически контролируемой машине. Он выбрал последнее и проходил курс в течение года.

Сначала казалось, что Тьюринг все это выносит спокойно, но 7 июня 1954 года он покончил жизнь самоубийством, откусив от яблока, пропитанного цианидом. Его друзья отмечали, что ему всегда нравилась сцена из «Белоснежки», в котором злая фея опускает яблоко в ядовитое варево. Он был найден в своей постели с пеной у рта, цианидом в теле и недоеденным яблоком, лежащим рядом с ним.

Способны ли так поступать машины?

Джон Бардин (1908–1991), Уильям Шокли (1910–1989), Уолтер Браттейн (1902–1987) в Bell Labs, 1948 г.

Первый транзистор, изготовленный в Bell Labs

Коллеги, в том числе Гордон Мур (сидит слева) и Роберт Нойс (стоит в центре с бокалом вина), произносят тосты в честь Уильяма Шокли (во главе стола) в день награждения его Нобелевской премией, 1956 г.

Из книги Раздумья ездового пса автора Ершов Василий ВасильевичМашина То, на чем я летаю по воздуху, называется «средний магистральный пассажирский самолёт Ту-154». Но как в английском языке слово «корабль» - женского рода, так и мы, лётчики, говорим о своём родном самолёте: «она», «машина». Кормилица наша. Одно это подразумевает, что мы,

Из книги Мемуарная проза автора Цветаева МаринаГОНЧАРОВА И МАШИНА В нашем живописании доселе все спевалось. Гончарова природы, народа, народов, со всей древностью деревенской крови в недавности дворянских жил, Гончарова - деревня, Гончарова - древность. Гончарова-дерево, древняя, деревенская, деревянная, древесная,

Из книги Московские тюрьмы автора Мясников Алексей«Так нельзя мыслить» Вдоль здания приемной городской прокуратуры задумчиво ходит бородатый человек. Длинные пряди спадают с лысеющей головы, сливаются с проседью бороды, большой, черно-бурой. Цепкие глаза внимательно ощупывают старинный орнамент фасада. Так занят этим,

Из книги Статьи из газеты «Известия» автора Быков Дмитрий Львович Из книги Том 4. Книга 1. Воспоминания о современниках автора Цветаева МаринаГончарова и машина В нашем живописании доселе все спевалось. Гончарова природы, народа, народов, со всей древностью деревенской крови в недавности дворянских жил, Гончарова - деревня, Гончарова - древность. Гончарова - дерево, древняя, деревенская, деревянная,

Из книги Путешествие рок-дилетанта автора Житинский Александр НиколаевичМАШИНА ВРЕМЕНИ Московская группа МАШИНА ВРЕМЕНИ возникла на рубеже 1968–1969 гг., в то время ее участники еще учились в школе. В одном из первых устойчивых составов играли А. Макаревич (гитара, вокал), А. Кутиков (бас), С. Кавагоэ (орган), Ю. Борзов (ударные). Поначалу в репертуар

Из книги Бизнес есть бизнес: 60 правдивых историй о том, как простые люди начали свое дело и преуспели автора Гансвинд Игорь Игоревич Из книги Исповедь четырех автора Погребижская ЕленаГлава третья Мыслить и страдать или кого потеряла отечественная философия Вот лично мне нравилось думать о себе, что я человек несентиментальный. И если у меня и были какие-то «безуханные» засохшие цветы между пожелтевшими страницами, то все это усилием воли давным-давно

Из книги Меланхолия гения. Ларс фон Триер. Жизнь, фильмы, фобии автора Торсен НильсМашина мечты Он поворачивает ключ в замке, и гольф-кар заводится с легким электрическим жужжанием. Потом он разворачивает машину, сворачивает с дороги и уверенной рукой рывками везет нас между красных и желтых зданий.– Вот они повеселились небось, когда разрабатывали

Из книги Размышления команданте автора Кастро ФидельМашина убийств Воскресенье – хороший день для чтения научной фантастики.Было объявлено, что ЦРУ намерено рассекретить сотни страниц материалов о своих незаконных действиях, в том числе планы по устранению глав иностранных правительств. Внезапно публикация этих

Из книги Воздушный путь автора Сикорский Игорь ИвановичЧто может дать аэроплан с одним двигателем и чего он не может дать После того как первые аэропланы поднялись в Европе на воздух, дело летания стало развиваться очень быстро и успешно. Железным дорогам понадобилось несколько десятилетий, чтобы войти в употребление в

автора Айзексон УолтерМожет ли машина мыслить? Когда Алан Тьюринг раздумывал о конструировании компьютера с сохраняемой программой, он обратил внимание на утверждение, сделанное Адой Лавлейс столетием ранее, в ее финальном “Примечании” к описанию аналитической машины Бэббиджа. Она

Из книги Инноваторы. Как несколько гениев, хакеров и гиков совершили цифровую революцию автора Айзексон Уолтер“Как мы можем мыслить” Идея создать персональный компьютер, который каждый мог бы иметь у себя дома, пришла в голову Вэнивару Бушу еще в 1945 году. Он собрал большой аналоговый компьютер в Массачусетском технологическом институте (МТИ) и наладил сотрудничество между

Из книги Ария Маргариты автора Пушкина Маргарита Анатольевна«Как мы можем мыслить» Идея создать персональный компьютер, который каждый мог бы иметь у себя дома, пришла в голову Вэнивару Бушу еще в 1945 году. Он собрал большой аналоговый компьютер в Массачусетском технологическом институте (МТИ) и наладил сотрудничество между

Из книги Лжетрактат о манипуляции. Фрагменты книги автора Бландиана АнаМАШИНА СМЕРТИ (музыка С.Терентьева)Думаю, эту песню в том виде, как она была записана для альбома «Химера», не услышит никто. В крайнем случае она появится на каком-нибудь сборнике. Скорее всего, Терентий творчески переработает ее, замедлит, пропустит через мясорубку

Из книги автораМашина у ворот Не припомню с точностью момент, когда она появилась напротив наших ворот, - в те времена, когда в Бухаресте было гораздо меньше автомобилей, чем сейчас, и на улице мест для парковки в изобилии, - эта белая шкода, а в ней женщина лет тридцати-сорока, крепкая

Алан Тьюринг предложил эксперимент, который позволил бы проверить наличие сознания у компьютера, а Джон Сёрль предложил мысленный эксперимент, который должен опровергать эксперимент Тьюринга. Разбираемся в обоих аргументах и заодно пытаемся понять, что такое сознание.

Тест Тьюринга

В 1950 году в работе «Вычислительные машины и разум» британский математик Алан Тьюринг предложил свой знаменитый тест, позволяющий, по его мнению, определить, способна ли та или иная вычислительная машина мыслить. Тест, по сути дела, копировал распространённую тогда в Британии игру в имитацию. В ней участвовали три человека: ведущий и мужчина с женщиной. Ведущий сидел за ширмой и мог общаться с двумя другими игроками только с помощью записок. Его задача состояла в том, чтобы угадать, какого пола каждый из его собеседников. При этом они вовсе не обязаны были отвечать правдиво на его вопросы.

Тот же самый принцип Тьюринг использовал и в тесте на наличие интеллекта у машины. Только ведущий в нём должен угадать не пол собеседника, а является ли он машиной или человеком. Если машина сможет достаточно успешно имитировать поведение человека и запутывать ведущего, то она пройдёт тест и, предположительно, докажет, что у неё есть сознание и что она мыслит.

Молодой Алан Тьюринг (фотография на паспорт).

Источник: Wikimedia.org

Китайская комната

В 1980 году философ Джон Сёрль предложил мысленный эксперимент, который мог бы опровергнуть позицию Тьюринга.

Представим себе следующую ситуацию. Человек, который не говорит и не читает на китайском языке, попадает в комнату. В этой комнате есть таблички с китайскими символами, а также книга на том языке, на котором разговаривает этот человек. В книге описано, что делать с символами, если в комнату попадут другие символы. Вне комнаты находится независимый наблюдатель, который говорит по-китайски. Его задача состоит в том, чтобы разговаривать с человеком из комнаты, например посредством записок, и выяснить, понимает ли его собеседник китайский язык.

Цель эксперимента Сёрля – продемонстрировать, что даже если наблюдатель поверит, что его собеседник умеет говорить по-китайски, человек в комнате всё равно не будет знать китайский язык. Он не будет понимать символов, которыми оперирует. Точно так же и «машина Тьюринга», которая смогла бы пройти одноимённый тест, не понимала бы символов, которые она использует, и, соответственно, не обладала бы сознанием.

По мнению Сёрля, даже если бы подобная машина смогла ходить, разговаривать, оперировать предметами и изображать из себя полноценного мыслящего человека, она всё равно не обладала бы сознанием, поскольку она только исполняла бы заложенную в неё программу, отвечая заданными реакциями на заданные сигналы.

Философский зомби

Однако представим себе следующую ситуацию, предложенную Дэвидом Чалмерсом в 1996 году. Представим себе так называемого «философского зомби» - некоторое существо, которое по всем признакам похоже на человека. Оно выглядит как человек, разговаривает как человек, реагирует на сигналы и раздражители как человек и вообще во всех возможных ситуациях ведёт себя как человек. Но при этом у него отсутствует сознание, и оно не испытывает никаких чувств. Оно реагирует на то, что причинило бы человеку боль или удовольствие, как если бы оно было человеком, который испытывает эти ощущения. Но при этом оно не переживает их на самом деле, а только имитирует реакцию.

Возможно ли такое существо? Как нам отличить его от реального человека, который испытывает чувства? Что вообще отличает философского зомби от людей? Может ли быть так, что они среди нас? А может быть, все, кроме нас, - философские зомби?

Дело в том, что нам в любом случае недоступен внутренний субъективный опыт других людей. Нам недоступно никакое сознание, кроме нашего собственного. Мы изначально только предполагаем, что у других людей оно есть, что они похожи на нас, потому что у нас в общем-то нет особых поводов в этом сомневаться, ведь другие ведут себя так же, как и мы.

В МИРЕ НАУКИ. (Scientific American. Издание на русском языке). 1990. № 3

Искусственный интеллект: различные взгляды на проблему

Последние 35 лет попыток создать думающие машины были полны и удач, и разочарований. «Интеллектуальный» уровень современных компьютеров довольно высок, однако для того, чтобы компьютеры могли «разумно» вести себя в реальном мире, их поведенческие способности не должны уступать способностям по крайней мере самых примитивных животных. Некоторые специалисты, работающие в областях, не связанных с искусственным интеллектом, говорят, что компьютеры по своей природе не способны к сознательной умственной деятельности.

В этом нормере журнала в статье Дж.Р.Сирла утверждается, что компьютерные программы никогда не смогут достичь разума в привычном для нас понимании. В то же время в другой статье, написанной П.М.Черчлендом и П. С.Черчленд приводится мнение, что с помощью электронных схем, построенных по образу и подобию мозговых структур, возможно удастся создать искусственный интеллект. За этим спором по существу скрывается вопрос о том, что такое мышление. Этот вопрос занимал умы людей на протяжении тысячелетий. Практическая работа с компьютерами, которые пока не могут мыслить, породила новый взгляд на этот вопрос и отвергла многие потенциальные ответы на него. Остается найти правильный ответ.

Разум мозга - компьютерная программа?

Нет. Программа лишь манипулирует символами, мозг же придает им смысл

ДЖОН СЁРЛ

СПОСОБНА ли машина мыслить? Может ли машина иметь сознанные мысли в таком же смысле, в каком имеем их мы? Если под машиной понимать физическую систему, способную выполнять определенные функции (а что еще под ней можно понимать?), тогда люди - это машины особой, биологической разновидности, а люди могут мыслить, и, стало быть, машины, конечно, тоже могут мыслить. Тогда, по всей видимости, можно создавать мыслящие машины из самых разнообразных материалов - скажем, из кремниевых кристаллов или электронных ламп. Если это и окажется невозможным, то пока мы, конечно, этого еще не знаем.

Однако в последние десятилетия вопрос о том, может ли машина мыслить, приобрел совершенно другую интерпретацию. Он был подменен вопросом: способна ли машина мыслить только за счет выполнения заложенной в нее компьютерной программы? Является ли программа основой мышления? Это принципиально иной вопрос, потому что он не затрагивает физических, каузальных (причинных) свойств существующих или возможных физических систем, а скорее относится к абстрактным, вычислительным свойствам формализованных компьютерных программ, которые могут быть реализованы в любом материале, лишь бы он был способен выполнять эти программы.

Довольно большое число специалистов по искусственному интеллекту (ИИ) полагают, что на второй вопрос следует ответить положительно; другими словами, они считают, что составив правильные программы с правильными входами и выходами, они действительно создадут разум. Более того, они полагают, что имеют в своем распоряжении научный тест, с помощью которого можно судить об успехе или неудаче такой попытки. Имеется в виду тест Тьюринга, изобретенный Аланом М. Тьюрингом, основоположником искусственного интеллекта. Тест Тьюринга в том смысле, как его сейчас понимают, заключается просто в следующем: если компьютер способен демонстрировать поведение, которое эксперт не сможет отличить от поведения человека, обладающего определенными мыслительными способностями (скажем, способностью вьшблнять операции сложения или понимать китайский язык), то компьютер также обладает этими способностями. Следовательно, цель заключается лишь в том, чтобы создать программы, способные моделировать человеческое мышление таким образом, чтобы выдерживать тест Тьюринга. Более того, такая программа будет не просто моделью разума; она в буквальном смысле слова сама и будет разумом, в том же смысле, в котором человеческий разум - это разум.

Конечно, далеко не каждый специалист по искусственному интеллекту разделяет такую крайнюю точку зрения. Более осторожный подход заключается в том, чтобы рассматривать компьютерные модели как полезное средство для изучения разума, подобно тому как они применяются при изучении погоды, пищеварения, экономики или механизмов молекулярной биологии. Чтобы провести различие между этими двумя подходами, я назову первый «сильным ИИ», а второй - «слабым ИИ». Важно понять, насколько радикальным является подход сильного ИИ. Сильный ИИ утверждает, что мышление - это не что иное, как манипулирование формализованными символами, а именно это и делает компьютер: он оперирует формализованными символами. Подобный взгляд часто суммируется примерно следующим высказыванием: «Разум по отношению к мозгу - это то же, что и программа по отношению к аппаратуре компьютера».

СИЛЬНЫЙ ИИ отличается от других теорий разума по крайней мере в двух отношениях: его можно четко сформулировать, но также четко и просто его можно опровергнуть. Характер этого опровержения таков, что каждый человек может попробовать провести его самостоятельно. Вот как это делается. Возьмем, например, какой-нибудь язык, которого вы не понимаете. Для меня таким языком является китайский. Текст, написанный по-китайски, я воспринимаю как набор бессмысленных каракулей. Теперь предположим, что меня поместили в комнату, в которой расставлены корзинки, полные китайских иероглифов. Предположим также, что мне дали учебник на английском языке, в котором приводятся правила сочетания символов китайского языка, причем правила эти можно применять, зная лишь форму символов, понимать значение символов совсем необязательно. Например, правила могут гласить: «Возьмите такой-то иероглиф из корзинки номер один и поместите его рядом с таким-то иероглифом из корзинки номер два».

Представим себе, что находящиеся за дверью комнаты люди, понимающие китайский язык, передают в комнату наборы символов и что в ответ я манипулирую символами согласно правилам и передаю обратно другие наборы символов. В данном случае книга правил есть не что иное, как «компьютерная программа». Люди, написавшие ее, - «программисты», а я играю роль «компьютера». Корзинки, наполненные символами, - это «база данных»; наборы символов, передаваемых в комнату, это «вопросы», а наборы, выходящие из комнаты, это «ответы».

Предположим далее, что книга правил написана так, что мои «ответы» на «вопросы» не отличаются от ответов человека, свободно владеющего китайским языком. Например, люди, находящиеся снаружи, могут передать непонятные мне символы, означающие; «Какой цвет вам больше всего нравится?» В ответ, выполнив предписанные правилами манипуляции, я выдам символы, к сожалению, мне также непонятные и означающие, что мой любимый цвет синий, но мне также очень нравится зеленый. Таким образом, я выдержу тест Тьюринга на понимание китайского языка. Но все же на самом деле я не понимаю ни слова по-китайски. К тому же я никак не могу научиться этому языку в рассматриваемой системе, поскольку не существует никакого способа, с помощью которого я мог бы узнать смысл хотя бы одного символа. Подобно компьютеру, я манипулирую символами, но не могу придать им какого бы то ни было смысла.

Сущность этого мысленного эксперимента состоит в следующем: если я не могу понять китайского языка только потому, что выполняю компьютерную программу для понимания китайского, то и никакой другой цифровой компьютер не сможет его понять таким образом. Цифровые компьютеры просто манипулируют формальными символами согласно правилам, зафиксированным в программе.

То, что касается китайского языка, можно сказать и о других формах знания. Одного умения манипулировать символами еще недостаточно, чтобы гарантировать знание, восприятие, понимание, мышление и т. д. И поскольку компьютеры как таковые - это устройства, манипулирующие символами, наличия компьютерной программы недостаточно, чтобы можно было говорить о наличии знания.

Этот простой аргумент имеет решающее значение для опровержения концепции сильного ИИ. Первая предпосылка аргумента просто констатирует формальный характер компьютерной программы. Программы определяются в терминах манипулирования символами, а сами символы носят чисто формальный, или «синтаксический» характер. Между прочим, именно благодаря формальной природе программы, компьютер является таким мощным орудием. Одна и та же программа может выполняться на машинах самой различной природы, равно как одна и та же аппаратная система способна выполнять самые разнообразные компьютерные программы. Представим это соображение кратко в виде «аксиомы»:

Аксиома 1. Компьютерные программы - это формальные (синтаксические) объекты.

Это положение настолько важно, что его стоит рассмотреть несколько подробнее. Цифровой компьютер обрабатывает информацию, сначала кодируя ее в символических обозначениях, используемых в машине, а затем манипулируя символами в соответствии с набором строго определенных правил. Эти правила представляют собой программу. Например, в рамках тьюринговской концепции компьютера в роли символов выступали просто 0 и 1, а правила программы предписывали такие операции, как «Записать 0 на ленте, продвинуться на одну ячейку влево и стереть 1». Компьютеры обладают удивительным свойством: любая представимая на естественном языке информация может быть закодирована в такой системе обозначений и любая задача по обработке информации может быть решена путем применения правил, которые можно запрограммировать.

ВАЖНОЕ значение имеют еще два момента. Во-первых, символы и программы - это чисто абстрактные понятия: они не обладают физическими свойствами, с помощью которых их можно было бы определить и реализовать в какой бы то ни было физической среде. Нули и единицы, как символы, не имеют физических свойств. Я акцентирую на этом внимание, поскольку иногда возникает соблазн отождествить компьютеры с той или иной конкретной технологией - скажем, с кремниевыми интегральными микросхемами - и считать, что речь идет о физических свойствах кремниевых кристаллов или что синтаксис означает какое-то физическое явление, обладающее, может быть, еще неизвестными каузальными свойствами аналогично реальным физическим явлениям, таким как электромагнитное излучение или атомы водорода, которые обладают физическими, каузальными свойствами. Второй момент заключается в том, что манипуляция символами осуществляется без всякой связи с каким бы то ни было смыслом. Символы в программе могут обозначать все, что угодно программисту или пользователю. В этом смысле программа обладает синтаксисом, но не обладает семантикой.

Следующая аксиома является простым напоминанием об очевидном факте, что мысли, восприятие, понимание и т. п. имеют смысловое содержание. Благодаря этому содержанию они могут служить отражением объектов и состояний реального мира. Если смысловое содержание связано с языком, то в дополнение к семантике, в нем будет присутствовать и синтаксис, однако лингвистическое понимание требует по крайней мере семантической основы. Если, например, я размышляю о последних президентских выборах, то мне в голову приходят определенные слова, но эти слова лишь потому относятся к выборам, что я придаю им специфическое смысловое значение в соответствии со своим знанием английского языка. В этом отношении они для меня принципиально отличаются от китайских иероглифов. Сформулируем это кратко в виде следующей аксиомы:

Аксиома 2. Человеческий разум оперирует смысловым содержанием (семантикой).

Теперь добавим еще один момент, который был продемонстрирован экспериментом с китайской комнатой. Располагать только символами как таковыми (т. е. синтаксисом) еще недостаточно для того, чтобы располагать семантикой. Простого манипулирования символами недостаточно, чтобы гарантировать знание их смыслового значения. Кратко представим это в виде аксиомы.

Аксиома 3. Синтаксис сам по себе не составляет семантику и его недостаточно для существования семантики.

На одном уровне этот принцип справедлив по определению. Конечно, кто-то может определить синтаксис и семантику по-иному. Главное, однако, в том, что существует различие между формальными элементами, не имеющими внутреннего смыслового значения, или содержания, и теми явлениями, у которых такое содержание есть. Из рассмотренных предпосылок следует:

Заключение 1. Программы не являются сущностью разума и их наличия недостаточно для наличия разума.

А это по существу означает, что утверждение сильного ИИ ложно.

Очень важно отдавать себе отчет в том, что именно было доказано с помощью этого рассуждения и что нет.

Во-первых, я не пытался доказывать, что «компьютер не может мыслить». Поскольку все, что поддается моделированию вычислениями, может быть описано как компьютер, и поскольку наш мозг на некоторых уровнях поддается моделированию, то отсюда тривиально следует, что наш мозг - это компьютер, и он, разумеется, способен мыслить. Однако из того факта, что систему можно моделировать посредством манипулирования символами и что она способна мыслить, вовсе не следует, что способность к мышлению эквивалентна способности к манипулированию формальными символами.

Во-вторых, я не пытался доказывать, что только системы биологической природы, подобные нашему мозгу, способны мыслить. В настоящее время это единственные известные нам системы, обладающие такой способностью, однако мы можем встретить во Вселенной и другие способные к осознанным мыслям системы, а может быть, мы даже сумеем искусственно создать мыслящие системы. Я считают этот вопрос открытым для споров.

В-третьих, утверждение сильного ИИ заключается не в том, что компьютеры с правильными программами могут мыслить, что они могут обладать какими-то неведомыми доселе психологическими свойствами; скорее, оно состоит в том, что компьютеры просто должны мыслить, поскольку их работа - это и есть не что иное, как мышление.

В-четвертых, я попытался опровергнуть сильный ИИ, определенный именно таким образом. Я пытался доказать, что мышление не сводится к программам, потому что программа лишь манипулирует формальными символами - а, как нам известно, самого по себе манипулирования символами недостаточно, чтобы гарантировать наличие смысла. Это тот принцип, на котором основано рассуждение о китайской комнате.

Я подчеркиваю здесь эти моменты отчасти потому, что П.М. и П.С.Черчленды в своей статье (см. Пол М. Черчленд и Патриция Смит Черчленд «Может ли машина мыслить?»), как мне кажется, не совсем правильно поняли суть моих аргументов. По их мнению, сильный ИИ утверждает, что компьютеры в конечном итоге могут обрести способность к мышлению и что я отрицаю такую возможность, рассуждая лишь на уровне здравого смысла. Однако сильный ИИ утверждает другое, и мои доводы против не имеют ничего общего со здравым смыслом.

Далее я скажу еще кое-что об их возражениях. А пока я должен заметить, что в противоположность тому, что говорят Черчленды, рассуждение с китайской комнатой опровергает любые утверждения сильного ИИ относительно новых параллельных технологий, возникших под влиянием и моделирующих работу нейронных сетей. В отличие от компьютеров традиционной архитектуры фон Неймана, работающих в последовательном пошаговом режиме, эти системы располагают многочисленными вычислительными элементами, работающими параллельно и взаимодействующими друг с другом в соответствии с правилами, основанными на открытиях нейробиологии. Хотя пока достигнуты скромные результаты, модели «параллельной распределенной обработки данных» или «коммутационные машины» подняли некоторые полезные вопросы относительно того, насколько сложными должны быть параллельные системы, подобные нашему мозгу, чтобы при их функционировании порождалось разумное поведение.

Однако параллельный, «подобный мозгу» характер обработки информации не является существенным для чисто вычислительных аспектов процесса. Любая функция, которая может быть вычислена на параллельной машине, будет вычислена и на последовательной. И действительно, ввиду того что параллельные машины еще редки, параллельные программы обычно все еще выполняются на традиционных последовательных машинах. Следовательно, параллельная обработка также не избегает аргумента, основанного на примере с китайской комнатой.

Более того, параллельные системы подвержены своей специфической версии первоначального опровергающего рассуждения в случае с китайской комнатой. Вместо китайской комнаты представьте себе китайский спортивный зал, заполненный большим числом людей, понимающих только английский язык. Эти люди будут выполнять те же самые операции, которые выполняются узлами и синапсами в машине коннекционной архитектуры, описанной Черчленда-ми, но результат будет тем же, что и в примере с одним человеком, который манипулирует символами согласно правилам, записанным в руководстве. Никто в зале не понимает ни слова по-китайски, и не существует способа, следуя которому вся система в целом могла бы узнать о смысловом значении хотя бы одного китайского слова. Тем не менее при правильных инструкциях эта система способна правильно отвечать на вопросы, сформулированные по-китайски.

У параллельных сетей, как я уже говорил, есть интересные свойства, благодаря которым они могут лучше моделировать мозговые процессы по сравнению с машинами с традиционной последовательной архитектурой. Однако преимущества параллельной архитектуры, существенные для слабого ИИ, не имеют никакого отношения к противопоставлению между аргументом, построенным на примере с китайской комнатой, и утверждением сильного ИИ. Черчленды упускают из виду этот момент, когда говорят, что достаточно большой китайский спортивный зал мог бы обладать более высокими умственными способностями, которые определяются размерами и степенью сложности системы, равно как и мозг в целом более «разумен», чем его отдельные нейроны. Возможно и так, но это не имеет никакого отношения к вычислительному процессу. С точки зрения выполнения вычислений последовательные и параллельные архитектуры совершенно идентичны: любое вычисление, которое может быть произведено в машине с параллельным режимом работы, может быть выполнено машиной с последовательной архитектурой. Если человек, находящийся в китайской комнате и производящий вычисления эквивалентен и той и другой системам, тогда, если он не понимает китайского языка исключительно потому, что ничего кроме вычислений не делает, то и эти системы также не понимают китайского языка. Черчленды правы, когда говорят, что первоначальный довод, основанный на примере с китайской комнатой, был сформулирован исходя из традиционного представления об ИИ, но они заблуждаются, считая что параллельная архитектура делает этот довод неуязвимым. Это справедливо в отношении любой вычислительной системы. Производя только формальные операции с символами (т. е. вычисления) вы не сможете обогатить свой разум семантикой, независимо от того выполняются эти вычислительные операции последовательно или параллельно; вот почему аргумент китайской комнаты опровергает сильный ИИ в любой его форме.

МНОГИЕ люди, на которых этот аргумент производит определенное впечатление, тем не менее затрудняются провести четкое различие между людьми и компьютерами. Если люди, по крайней мере в тривиальном смысле, являются компьютерами и если люди обладают семантикой, то почему они не могут наделить семантикой и другие компьютеры? Почему мы не можем запрограммировать компьютеры Vax или Cray таким образом, чтобы у них тоже появились мысли и чувства? Или почему какая-нибудь новая компьютерная технология не сможет преодолеть пропасть, разделяющую форму и содержание, или синтаксис и семантику? В чем на самом деле состоит то различие между биологическим мозгом и компьютерной системой, благодаря которому аргумент с китайской комнатой действует применительно к компьютерам, но не действует применительно к мозгу?

Наиболее очевидное различие заключается в том, что процессы, которые определяют нечто как компьютер (а именно вычислительные процессы), на самом деле совершенно не зависят от какого бы то ни было конкретного типа аппаратной реализации. В принципе можно сделать компьютер из старых жестяных банок из-под пива, соединив их проволокой и обеспечив энергией от ветряных мельниц.

Однако когда мы имеем дело с мозгом, то хотя современная наука в значительной степени еще пребывает в неведении относительно протекающих в мозгу процессов, мы поражаемся чрезвычайной специфичности анатомии и физиологии. Там, где мы достигли некоторого понимания того, как мозговые процессы порождают те или иные психические явления, - например, боль, жажду, зрение, обоняние - нам ясно, что в этих процессах участвуют вполне определенные нейробиологические механизмы. Чувство жажды, по крайней мере в некоторых случаях, обусловлено срабатыванием нейронов определенных типов в гипоталамусе, которое в свою очередь вызвано действием специфического пептида, ангиотензина II. Причинные связи прослеживаются здесь «снизу вверх» в том смысле, что нейронные процессы низшего уровня обусловливают психические явления на более высоких уровнях. В самом деле, каждое «ментальное» явление, от чувства жажды до мыслей о математических теоремах и воспоминаний о детстве, вызывается срабатыванием определенных нейронов в определенных нейронных структурах.

Однако почему эта специфичность имеет такое важное значение? В конце концов всевозможные срабатывания нейронов можно смоделировать на компьютерах, физические и химические свойства которых совершенно отличны от свойств мозга. Ответ состоит в том, что мозг не просто демонстрирует формальные процедуры или программы (он делает и это тоже), но и вызывает ментальные события благодаря специфическим нейробиологическим процессам. Мозг по сути своей является биологическим органом и именно его особые биохимические свойства позволяют достичь эффекта сознания и других видов ментальных явлений. Компьютерные модели мозговых процессов обеспечивают отражение лишь формальных аспектов этих процессов. Однако моделирование не следует смешивать с воспроизведением. Bычислительные модели ментальных процессов не ближе к реальности, чем вычислительные модели любого другого природного явления.

Можно представить себе компьютерную модель, отражающую воздействие пептидов на гипоталамус, которая будет точна вплоть до каждого отдельного синапса. Но с таким же успехом мы можем представить себе компьютерное моделирование процесса окисления углеводородов в автомобильном двигателе или пищеварительного процесса в желудке. И модель процессов, протекающих в мозге, ничуть не реальнее моделей, описывающих процессы сгорания топлива или пищеварительные процессы. Если не говорить о чудесах, то вы не сможете привести свой автомобиль в движение, моделируя на компьютере окисление бензина, и вы не сможете переварить обед, выполняя программу, которая моделирует пищеварение. Представляется очевидным и тот факт, что и моделирование мышления также не произведет нейробиологического эффекта мышления.

Следовательно, все ментальные явления вызываются нейробиологическими процессами мозга. Представим сокращенно этот тезис следующим образом:

Аксиома 4. Мозг порождает разум.

В соответствии с рассуждениями, приведенными выше, я немедленно прихожу к тривиальному следствию.

Заключение 2. Любая другая система, способная порождать разум, должна обладать каузальными свойствами (по крайней мере), эквивалентными соответствующим свойствам мозга.

Это равносильно, например, следующему утверждению: если электрический двигатель способен обеспечивать автомашине такую же высокую скорость, как двигатель внутреннего сгорания, то он должен обладать (по крайней мере) эквивалентной мощностью. В этом заключении ничего не говорится о механизмах. На самом деле, мышление - это биологическое явление: психические состояния и процессы обусловлены процессами мозга. Из этого еще не следует, что только биологическая система может мыслить, но это в то же время означает, что любая система другой природы, основанная на кремниевых кристаллах, жестяных банках и т. п., должна будет обладать каузальными возможностями, эквивалентными соответствующим возможностям мозга. Таким образом, я прихожу к следующему выводу:

Заключение 3. Любой артефакт, порождающий ментальные явления, любой искусственный мозг должен иметь способность вопроизводить специфические каузальные свойства мозга, и наличия этих свойств невозможно добиться только за счет выполнения формальной программы.

Более того, я прихожу к важному выводу, касающемуся человеческого мозга:

Заключение 4. Тот способ, посредством которого человеческий мозг на самом деле порождает ментальные явления, не может сводиться лишь к выполнению компьютерной программы.

ВПЕРВЫЕ сравнение с китайской комнатой было приведено мною на страницах журнала "Behavioral and Brain Sciences" (Науки о поведении и мозге) в 1980 г. Тогда моя статья сопровождалась, в соответствии с принятой в этом журнале практикой, комментариями оппонентов, в данном случае свои соображения высказали 26 оппонентов. Откровенно говоря, мне кажется, что смысл этого сравнения довольно очевиден, но, к моему удивлению, статья и в дальнейшем вызвала целый поток возражений, и что еще более удивительно, этот поток продолжается и по сей день. По-видимому, аргумент китайской комнаты затронул какое-то очень больное место.

Основной тезис сильного ИИ заключается в том, что любая система (независимо, сделана ли она из пивных банок, кремниевых кристаллов или просто из бумаги) не только способна обладать мыслями и чувствами, но просто должна ими обладать, если только она реализует правильно составленную программу, с правильными входами и выходами. Очевидно, это абсолютно антибиологическая точка зрения, и естественно было бы ожидать, что специалисты по искусственному интеллекту охотно откажутся от нее. Многие из них, особенно представители молодого поколения, согласны со мной, но меня поражает, как много сторонников имеет эта точка зрения и как настойчиво они защищают ее. Приведу некоторые наиболее распространенные из высказываемых ими доводов:

а) В китайской комнате вы на самом деле понимаете китайский, хотя и не отдаете себе в этом отчета. В конце концов вы можете понимать что-то и не отдавая себе в этом отчета.

б) Вы не понимаете китайского, но в вас существует подсистема (подсознание), которая понимает. Существуют ведь подсознательные психические состояния, и нет причины считать, что ваше понимание китайского не могло бы быть полностью неосознанным.

в) Вы не понимаете китайского, но комната как целое - понимает. Вы подобны отдельному нейрону в мозгу, и нейрон как таковой не может ничего понимать, он лишь вносит свой вклад в то понимание, которое демонстрирует система в целом; вы сами не понимаете, но вся система понимает.

г) Никакой семантики и не существует: есть только синтаксис. Полагать, что в мозгу есть какое-то загадочное «психическое содержание», «мыслительные процессы» или «семантика», это своего рода донаучная иллюзия. Все, что на самом деле существует в мозгу, - это некоторое синтаксическое манипулирование символами, которое осуществляется и в компьютерах. И ничего больше.

д) В действительности вы не выполняете компьютерную программу - это вам только кажется. Если существует некий сознательный агент, следующий строкам программы, то процесс уже вовсе не является простой реализацией программы.

е) Компьютеры обладали бы семантикой, а не только синтаксисом, если бы их входы и выходы были поставлены в причинные, каузальные зависимости - по отношению к остальному миру. Допустим, что мы снабдили робота компьютером, подключили телевизионные камеры к его голове, установили трансдьюсеры, подводящие телевизионную информацию к компьютеру, и позволили последнему управлять руками и ногами робота. В таком случае система как целое будет обладать семантикой.

ж) Если программа моделирует поведение человека, говорящего по-китайски, то она понимает китайский язык. Предположим, что нам удалось смоделировать работу мозга китайца на уровне нейронов. Но тогда, конечно, подобная система будет понимать китайский так же хорошо, как и мозг любого китайца.

У всех этих доводов есть одно общее свойство: все они неадекватны рассматриваемой проблеме, потому что не улавливают самой сути рассуждения о китайской комнате. Эта суть заключается в различии между формальным манипулированием символами, осуществляемым компьютером, и смысловым содержанием, биологически порождаемым мозгом, - различии, которое я для краткости выражения (и надеюсь, что это никого не введет в заблуждение) свел к различию между синтаксисом и семантикой. Я не буду повторять своих ответов на все эти возражения, однако проясню, возможно, ситуацию, если скажу, в чем заключаются слабости наиболее распространенного довода моих оппонентов, а именно довода (в), который я назову ответом системы. (Очень часто встречается также и довод (ж), основанный на идее моделирования мозга, но он уже был рассмотрен выше.)

В ОТВЕТЕ системы утверждается, что вы, конечно, не понимаете китайского, но вся система в целом - вы сами, комната, свод правил, корзинки, наполненные символами, - понимает. Когда я впервые услышал это объяснение, я спросил высказавшего это объяснение человека: «Вы что же, считаете, что комната может понимать китайский язык?» Он ответил, да. Это, конечно, смелое утверждение, однако, помимо того что оно совершенно неправдоподобно, оно не состоятельно еще и с чисто логической точки зрения. Суть моего исходного аргумента была в том, что простое тасование символов еще не обеспечивает доступа к пониманию смысла этих символов. Но это в той же мере касается комнаты в целом, как и находящегося в ней человека. В правоте моих слов можно убедиться, несколько расширив наш мысленный эксперимент. Представим себе, что я заучил наизусть содержимое корзинок и книги правил и что я провожу все вычисления в уме. Допустим даже, что я работаю не в комнате, а у всех на виду. В системе не осталось ничего такого, чего бы не было во мне самом, но поскольку я не понимаю китайского языка, не понимает его и система.

В своей статье мои оппоненты Черчленды используют одну из разновидностей ответа системы, придумав любопытную аналогию. Предположим, кто-то стал утверждать, что свет не может иметь электромагнитную природу, поскольку, когда человек перемещает магнит в темной комнате, мы не наблюдаем видимого светового излучения. Приведя этот пример, Черчленды спрашивают, а не является ли аргумент с китайской комнатой чем-то в том же роде? Не равносильно ли будет сказать, что когда вы манипулируете китайскими иероглифами в семантически темной комнате, в ней не возникает никакого просвета в понимании китайского языка? Но не может ли потом в ходе будущих исследований выясниться - так же, как было доказано, что свет все-таки целиком состоит из электромагнитного излучения, - что семантика целиком и полностью состоит из синтаксиса? Не является ли этот вопрос предметом дальнейшего научного изучения?

Аргументы, построенные на аналогиях, всегда очень уязвимы, поскольку, прежде чем аргумент станет состоятельным, необходимо еще убедиться, что две рассматриваемые ситуации действительно аналогичны. В данном случае, я думаю, что это не так. Объяснение света на основе электромагнитного излучения - это причинное рассуждение от начала и до конца. Это причинное объяснение физики электромагнитных волн. Однако аналогия с формальными символами не состоятельна, поскольку формальные символы не имеют физических причинных свойств. Единственное, что во власти символов как таковых, - это вызвать следующий шаг в программе, которую выполняет работающая машина. И здесь не возникает никакой речи о дальнейших исследованиях, которым еще предстоит раскрыть доселе неизвестные физические причинные свойства нулей и единиц. Последние обладают лишь одним видом свойств - абстрактными вычислительными свойствами, которые уже хорошо изучены.

Черчленды говорят, что у них «напрашивается вопрос», когда я утверждаю, что интерпретированные формальные символы не идентичны смысловому содержанию. Да, я, конечно, не тратил много времени на доказательство, что это так, поскольку я считаю это логической истиной. Как и в случае с любой другой логической истиной, каждый может быстро убедиться, что она справедлива, поскольку, предположив обратное, сразу приходишь к противоречию. Попробуем провести такое доказательство. Предположим, что в китайской комнате имеет место какое-то скрытое понимание китайского языка. Что же может превратить процесс манипулирования синтаксическими элементами в специфично китайское смысловое содержание? Подумав, я в конце концов пришел к выводу, что программисты должны были говорить по-китайски, коль скоро они сумели запрограммировать систему для обработки информации, представленной на китайском языке.

Хорошо. Но теперь представим себе, что надоело, сидя в китайской комнате, тасовать китайские (для меня бессмысленные) символы. Предположим, мне пришло в голову интерпретировать эти символы как обозначения ходов в шахматной игре. Какой семантикой теперь обладает система? Обладает ли она китайской семантикой или шахматной, или она обладает одновременно и той и другой? Предположим, что есть еще некая третья личность, наблюдающая за мной в окошко, и она решает, что мое манипулирование символами можно интерпретировать как предсказание курса акций на бирже. И так далее. Не существует предела количеству семантических интерпретаций, которое можно приписать символам, поскольку, я повторяю, символы носят чисто формальный характер. Они не содержат в себе внутренней семантики.

Можно ли каким-то образом спасти аналогию Черчлендов? Выше я сказал, что формальные символы не имеют каузальных свойств. Но, конечно, программа всегда выполняется той или иной конкретной аппаратурой, и эта аппаратура обладает своими специфическими физическими, каузальными свойствами. Любой реальный компьютер порождает различные физические явления. Мой компьютер, к примеру, выделяет тепло, производит монотонный шум и т. д. Существует ли здесь какое-либо строгое логическое доказательство, что компьютер не может производить аналогичным образом эффект сознания? Нет. В научном смысле об этом и речи быть не может, однако это совсем не то, что призвано опровергать рассуждение о китайской комнате, и не то, на чем будут настаивать сторонники сильного ИИ, поскольку любой производимый таким образом эффект будет достигать за счет физических свойств реализующей программу среды. Основное утверждение сильного ИИ заключается в том, что физические свойства реализующей среды не имеют никакого значения. Имеют значение лишь программы, а программы - это чисто формальные объекты.

Таким образом аналогия Черчлендов между синтаксисом и электромагнитным излучением наталкивается на дилемму: либо синтаксис следует понимать чисто формально, через его абстрактные математические свойства, либо нет. Если выбрать первую альтернативу, то аналогия становится несостоятельной, поскольку синтаксис, понимаемый таким образом, не имеет физических свойств. Если же, с другой стороны, рассматривать синтаксис в плоскости физических свойств реализующей среды, тогда аналогия действительно состоятельна, но она не имеет отношения к сильному ИИ.

ПОСКОЛЬКУ сделанные мною утверждения довольно очевидны - синтаксис это не то же самое, что семантика; мозговые процессы порождают психические явления - возникает вопрос, а как вообще возникла эта путаница? Кому могло прийти в голову, что компьютерное моделирование ментального процесса полностью ему идентично? В конце концов весь смысл моделей заключается в том, что они улавливают лишь какую-то часть моделируемого явления и не затрагивают остального. Ведь никто не думает, что мы-захотим поплавать в бассейне, наполненном шариками для пинг-понга, моделирующими молекулы воды. Можно ли тогда считать, что компьютерная модель мыслительных процессов на самом деле способна мыслить?

Отчасти эти недоразумения объясняются тем, что люди унаследовали некоторые положения -бихевиористских психологических теорий прошлого поколения. Под тестом Тьюринга скрывается соблазн считать, что если нечто ведет себя так, как будто оно обладает ментальными процессами, то оно и на самом деле должно ими обладать. Частью ошибочной бихевиористской концепции было также и то, что психология, для того чтобы оставаться научной дисциплиной, должна ограничиваться изучением внешне наблюдаемого поведения. Парадоксально, но этот остаточный бихевиоризм связан с остаточным дуализмом. Никто не думает, что компьютерная модель пищеварения способна что-то переварить на самом деле, но там, где речь идет о мышлении, люди охотно верят в такие чудеса, потому что забывают о том, что разум - это такое же биологическое явление, как и пищеварение. По их мнению, разум - это нечто формальное и абстрактное, а вовсе не часть полужидкой субстанции, из которой состоит наш головной мозг. Полемическая литература по искусственному интеллекту обычно содержит нападки на то, что авторы называют дуализмом, но при этом они не замечают, как сами демонстрируют ярко выраженный дуализм, поскольку если не принять точку зрения, что разум совершенно не зависит от мозга или какой-либо другой физически специфической системы, то следует считать невозможным создание разума только за счет написания программ.

Исторически в странах Запада научные концепции, в которых люди рассматривались как часть обычного физического или биологического мира, часто встречали противодействие со стороны реакции. Идеям Коперника и Галилея противились, потому что они отрицали, что Земля является центром Вселенной. Против Дарвина выступали потому, что он утверждал, что люди произошли от низших животных. Сильный ИИ правильнее всего было бы рассматривать как одно из последних проявлений этой антинаучной традиции, так как он отрицает, что человеческий разум содержит что-то существенно физическое или биологическое. Согласно утверждениям сильного ИИ, разум не зависит от мозга. Он представляет собой компьютерную программу и по существу не связан ни с какой специфической аппаратурой.

Многие люди, сомневающиеся относительно физической значимости искусственного интеллекта, полагают, что компьютеры, может быть, и смогут понимать китайский язык или думать о числах, но принципиально не способны на проявления чисто человеческих свойств, а именно (и далее следует их излюбленная человеческая специфика): любовь, чувство юмора, тревога за судьбу постиндустриального общества в эпоху современного капитализма и т. д. Но специалисты по ИИ справедливо настаивают, что эти возражения не корректны, что здесь как бы отодвигаются футбольные ворота. Если искусственное моделирование интеллекта окажется успешным, то психологические вопросы уже не имеют сколь-нибудь важного значения, В этом споре обе стороны не замечают различия между моделированием и воспроизведением. Пока речь идет о моделировании, то не стоит никакого труда запрограммировать мой компьютер, чтобы он напечатал: «Я люблю тебя, Сюзи»; «Ха-ха!» или «Я испытываю тревоги постиндустриального общества». Важно отдавать себе отчет в том, что моделирование - это не то же самое, что воспроизведение; и этот факт имеет такое же отношение к размышлениям об арифметике, как и к чувству тревоги. Дело не в том, что компьютер доходит только до центра поля и не доходит до ворот. Компьютер даже не трогается с места. Он просто не играет в эту игру.

Искусственный интеллект: Может ли машина мыслить?

Классический искусственный интеллект едва ли будет воплощен в мыслящих машинах; предел человеческой изобретательности в этой области, по-видимому, ограничится созданием систем, имитирующих работу мозга

ПОЛ М. ЧЕРЧЛЕНД, ПАТРИЦИЯ СМИТ ЧЕРЧЛЕНД

В НАУКЕ об искусственном интеллекте (ИИ) происходит революция. Чтобы объяснить ее причины и смысл и представить рассуждения Джона Р. Сирла в перспективе, мы прежде должны обратиться к истории.

В начале 50-х годов традиционный, несколько расплывчатый вопрос о том, может ли машина мыслить, уступил более доступному вопросу: может ли мыслить машина, манипулирующая физическими символами в соответствии с правилами, учитывающими их структуру. Этот вопрос сформулирован точнее, потому что за предшествовавшие полвека формальная логика и теория вычислений существенно продвинулись вперед. Теоретики стали высоко оценивать возможности абстрактных систем символов, которые претерпевают преобразования в соответствии с определенными правилами. Казалось, что если эти системы удалось бы автоматизировать, то их абстрактная вычислительная мощь проявилась бы в реальной физической системе. Подобные взгляды способствовали рождению вполне определенной программы исследований на достаточно глубокой теоретической основе.

Может ли машина мыслить? Было много причин для того, чтобы ответить да. Исторически одна из первых и наиболее глубоких причин заключалась в двух важных результатах теории вычислений. Первый результат был тезисом Черча, согласно которому каждая эффективно вычислимая функция является рекурсивно вычислимой. Термин «эффективно вычислимая» означает, что существует некая «механическая» процедура, с помощью которой можно за конечное время вычислить результат при заданных входных данных. «Рекурсивно вычислимая» означает, что существует конечное множество операций, которые можно применить к заданному входу, а затем последовательно и многократно применять к вновь получаемым результатам, чтобы вычислить функцию за конечное время. Понятие механической процедуры не формальное, а скорее интуитивное, и потому тезис Черча не имеет формального доказательства. Однако он проникает в самую суть того, чем является вычисление, и множество различных свидетельств сходится в его подтверждение.

Второй важный результат был получен Аланом М. Тьюрингом, продемонстрировавшим, что любая рекурсивно вычислимая функция может быть вычислена за конечное время с помощью максимально упрощенной машины, манипулирующей символами, которую позднее стали называть универсальной машиной Тьюринга. Эта машина управляется рекурсивно применимыми правилами, чувствительными к идентичности, порядку и расположению элементарных символов, которые играют роль входных данных.

ИЗ ЭТИХ двух результатов вытекает очень важное следствие, а именно что стандартный цифровой компьютер, снабженный правильной программой, достаточно большой памятью и располагающий достаточным временем, может вычислить любую управляемую правилами функцию с входом и выходом. Другими словами, он может продемонстрировать любую систематическую совокупность ответов на произвольные воздействия со стороны внешней среды.

Конкретизируем это следующим образом: рассмотренные выше результаты означают, что соответственно запрограммированная машина, манипулирующая символами (в дальнейшем будем называть ее МС-машиной), должна удовлетворять тесту Тьюринга на наличие сознательного разума. Тест Тьюринга - это чисто бихевиористский тест, тем не менее его требования очень сильны. (Насколько состоятелен этот тест, мы рассмотрим ниже, там где встретимся со вторым, принципиально отличным «тестом» на наличие сознательного разума.) Согласно первоначальной версии теста Тьюринга, входом для МС-машины должны быть вопросы и фразы на естественном разговорном языке, которые мы набираем на клавиатуре устройства ввода, а выходом являются ответы МС-машины, напечатанные устройством вывода. Считается, что машина выдержала этот тест на присутствие сознательного разума, если ее ответы невозможно отличить от ответов, напечатанных реальным, разумным человеком. Конечно, в настоящее время никому не известна та функция, с помощью которой можно было бы получить выход, не отличающийся от поведения разумного человека. Но результаты Черча и Тьюринга гарантируют нам, что какова бы ни была эта (предположительно эффективная) функция, МС-машина соответствующей конструкции сможет ее вычислить.

Это очень важный вывод, особенно если учесть, что тьюринговское описание взаимодействия с машиной при помощи печатающей машинки представляет собой несущественное ограничение. То же заключение остается в силе, даже если МС-машина взаимодействует с миром более сложными способами: с помощью аппарата непосредственного зрения, естественной речи и т. д. В конце концов более сложная рекурсивная функция все же остается вычислимой по Тьюрингу. Остается лишь одна проблема: найти ту несомненно сложную функцию, которая управляет ответными реакциями человека на воздействия со стороны внешней среды, а затем написать программу (множество рекурсивно применимых правил), с помощью которой МС-машина вычислит эту функцию. Вот эти цели и легли в основу научной программы классического искусственного интеллекта.

Первые результаты были обнадеживающими. МС-машины с остроумно составленными программами продемонстрировали целый ряд действий, которые как будто относятся к проявлениям разума. Они реагировали на сложные команды, решали трудные арифметические, алгебраические и тактические задачи, играли в шашки и шахматы, доказывали теоремы и поддерживали простой диалог. Результаты продолжали улучшатьсгя с появлением более емких запоминающих устройств, более быстродействующих машин, а также с разработгюй более мощных и изощренных программ. Классический, или «построенный на программировании», ИИ представлял собой очень живое и успешное научное направление почти со всех точек зрения. Периодически высказывавшееся отрицание того, что МС-машины в конечном итоге будут способны мыслить, казалось проявлением необъективности и неинформированности. Свидетельства в пользу положительного ответа на вопрос, вынесенный в заголовок статьи, казались более чем убедительными.

Конечно, оставались кое-какие неясности. Прежде всего МС-машины не очень-то напоминали человеческий мозг. Однако и здесь у классического ИИ был наготове убедительный ответ. Во-первых, физический материал, из которого сделана МС-машина, по существу не имеет никакого отношения к вычисляемой ею функции. Последняя зафиксирована в программе. Во-вторых, техничекие подробности функциональной архитектуры машины также не имеют значения, поскольку совершенно различные архитектуры, рассчитанные на работу с совершенно различными программами, могут тем не менее выполнять одну и ту же функцию по входу-выходу.

Поэтому целью ИИ было найти функцию, по входу и выходу характерную для разума, а также создать наиболее эффективную из многих возможных программ для того, чтобы вычислить эту функцию. При этом говорили, что тот специфичный способ, с помощью которого функция вычисляется человеческим мозгом, не имеет значения. Этим и завершается описание сущности классического ИИ и оснований для положительного ответа на вопрос, поставленный в заголовке статьи.

МОЖЕТ ЛИ машина мыслить? Были также кое-какие доводы и в пользу отрицательного ответа. На протяжении 60-х годов заслуживающие внимания отрицательные аргументы встречались относительно редко. Иногда высказывалось возражение, заключающееся в том, что мышление - это не физический процесс и протекает он в нематериальной душе. Однако подобное дуалистическое воззрение не выглядело достаточно убедительным ни с эволюционной, ни с логической точки зрения. Оно не оказало сдерживающего влияния на исследования в области ИИ.

Гораздо большее внимание специалистов по ИИ привлекли соображения иного характера. В 1972 г. Хьюберт Л. Дрейфус опубликовал книгу, в которой резко критиковались парадные демонстрации проявлений разума у систем ИИ. Он указывал на то, что эти системы не адекватно моделировали подлинное мышление, и вскрыл закономерность, присущую всем этим неудачным попыткам. По его мнению, в моделях отсутствовал тот огромный запас неформализованных общих знаний о мире, которым располагает любой человек, а также способность, присущая здравому рассудку, опираться на те или иные составляющие этих знаний,в зависимости от требований изменяющейся обстановки. Дрейфус не отрицал принципиальной возможности создания искусственной физичесгсой системы, способной мыслить, но он весьма критически отнесся к идее о том, что это может быть достигнуто только за счет манипулирования символами с помощью рекурсивно применяемых правил.

В кругах специалистов по искусственному интеллекту, а также философов рассуждения Дрейфуса были восприняты главным образом как недальновидные и необъективные, базирующиеся на неизбежных упрощениях, присущих этой еще очень молодой области исследований. Возможно, указанные недостатки действительно имели место, но они, конечно, были временными. Настанет время, когда более мощные машины и более качественные программы позволят избавиться от этих недостатков. Казалось, что время работает на искусственный интеллект. Таким образом, и эти возражения не оказали сколько-нибудь заметного влияния на дальнейшие исследования в области ИИ.

Однако оказалось, что время работало и на Дрейфуса: в конце 70-х - начале 80-х годов увеличение быстродействия и объема памяти компьютеров повышало их «умственные способности» ненамного. Выяснилось, например, что распознавание образов в системах машинного зрения требует неожиданно большого объема вычислений. Для получения практически достоверных результатов нужно было затрачивать все больше и больше машинного времени, намного превосходя время, требуемое для выполнения тех же задач биологической системе зрения. Столь медленный процесс моделирования настораживал: ведь в компьютере сигналы распространяются приблизительно в миллион раз быстрее, чем в мозге, а тактовая частота центрального процессорного устройства компьютера примерно во столько же раз выше частоты любых колебаний, обнаруженных в мозге. И все же на реалистических задачах черепаха легко обгоняет зайца.

Кроме того, для решения реалистических задач необходимо, чтобы компьютерная программа обладала доступом к чрезвычайно обширной базе данных. Построение такой базы данных уже само по себе представляет довольно сложную проблему, но она усугубляется еще одним обстоятельством: каким образом обеспечить доступ к конкретным, зависящим от контекста фрагментам этой базы данных в реальном масштабе времени. По мере того как базы данных становились все более емкими, проблема доступа осложнялась. Исчерпывающий поиск занимал слишком много времени, а эвристические методы не всегда приводили к успеху. Опасения, подобные тем, что высказывал Дрейфус, начали разделять даже некоторые специалисты, работающие в области искусственного интеллекта.

Приблизительно в это время (1980 г.) Джон Сирл высказал принципиально новую критическую концепцию, ставившую под сомнение само фундаментальное предположение классической программы исследований по ИИ, а именно - идею о том, что правильное манипулирование структурированными символами путем рекурсивного применения правил, учитывающих их структуру, может составлять сущность сознательного разума.

Основной аргумент Сирла базировался на мысленном эксперименте, в котором он демонстрирует два очень важных обстоятельства. Во-первых, он описывает МС-машину, которая (как мы должны понимать) реализует функцию, по входу и выходу способную выдержать тест Тьюринга в виде беседы, протекающей исключительно на китайском языке. Во-вторых, внутренняя структура машины такова, что независимо от того, какое поведение она демонстрирует, у наблюдателя не возникает сомнений в том, что ни машина в целом, ни любая ее часть не понимают китайского языка. Все, что она в себе содержит, - это говорящий только по-английски человек, выполняющий записанные в инструкции правила, с помощью которых следует манипулировать символами, входящими и выходящими через окошко для почтовой корреспонденции в двери. Короче говоря, система положительно удовлетворяет тесту Тьюринга, несмотря на то что не обладает подлинным пониманием китайского языка и реального семантического содержания сообщений (см. статью Дж. Сирла «Разум мозга - компьютерная программа?»).